Naukowcy osiągnęli kamień milowy w rozwoju technologii interfejsu mózg-komputer (BCI): małpy rezusy z powodzeniem poruszały się po złożonych środowiskach wirtualnych, korzystając wyłącznie z sygnałów neuronowych. W przeciwieństwie do poprzednich metod, które wymagały od osób badanych naśladowania określonych ruchów fizycznych, to nowe podejście wykorzystuje ośrodki planowania wyższego poziomu w mózgu, potencjalnie rewolucjonizując sposób, w jaki osoby z paraliżem wchodzą w interakcję z otaczającym ich światem.

Przełom: wyjście poza „ruszanie uszami”

Tradycyjne technologie BCI często opierają się na procesie fizycznego podstawienia. Na przykład użytkownik może zostać poproszony o wyobrażenie sobie przesuwania określonego palca w celu przesunięcia kursora na ekranie. Jak zauważa badacz Peter Janssen z Uniwersytetu w Leuven (KU Leuven), wielu użytkowników uważa ten proces za nieintuicyjny i przypomina irytujące uczucie „próby poruszania uszami”. To obce zadanie, wymagające ogromnego wysiłku umysłowego i długiego treningu.

Badania prowadzone przez Janssena zmieniają ten paradygmat, skupiając się na innych obszarach mózgu. Zespół wszczepił trzem małpom rezusom układy elektrod o dużej gęstości (96 elektrod każda) w trzech różnych obszarach:

– Pierwotna kora ruchowa: obszar odpowiedzialny za wykonywanie ruchów fizycznych.

– Grzbietowa i brzuszna kora przedruchowa: obszary uważane za zaangażowane w abstrakcyjne planowanie ruchów.

Angażując te ośrodki „planowania”, badacze starają się uchwycić intencję wykonania ruchu, a nie tylko mechaniczne polecenie skurczu mięśnia.

Wszechstronność w środowisku wirtualnym

Znaczenie tej kontroli opartej na „intencji” zostało zademonstrowane poprzez kilka zadań o rosnącej złożoności. Wykorzystując model sztucznej inteligencji do interpretacji sygnałów elektrycznych, małpy były w stanie:

1. Kontroluj kulę poruszającą się po krajobrazie 2D ze stałego punktu widzenia.

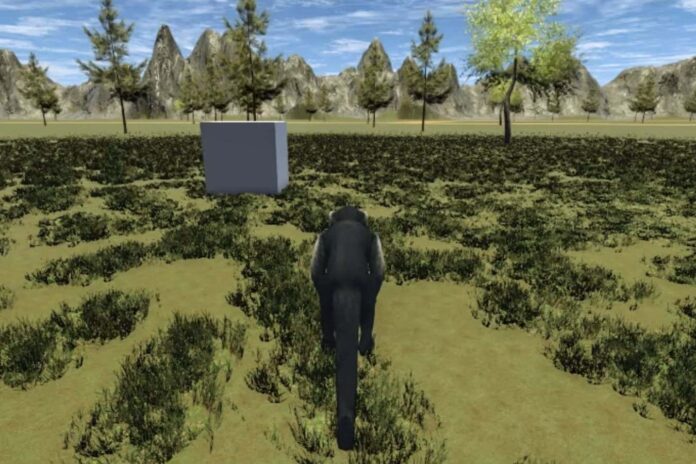

2. Manewruj animowanymi awatarami z widoku trzeciej osoby, podobnie jak we współczesnych grach wideo.

3. Nawiguj po wirtualnych budynkach, łącznie z trudnym zadaniem przemieszczania się z pokoju do pokoju i otwierania drzwi.

Andrew Jackson z Newcastle University podkreślił najbardziej imponujący aspekt tych wyników: elastyczność kontekstowa. Małpy były w stanie zastosować te same polecenia neuronowe w różnych perspektywach i środowiskach. Sugeruje to, że BCI udało się znaleźć „uniwersalny” język ruchu w mózgu – podobny do tego, w jaki sposób człowiek może używać standardowego kontrolera do gier w szerokiej gamie gier bez konieczności ponownego uczenia się za każdym razem, jak trzymać urządzenie.

Od naczelnych po ludzi

Choć rezultaty są rewolucyjne, przejście na ludzi korzystających z tej technologii nie będzie natychmiastowe. Główna trudność polega na dokładności neuroanatomicznej. Chociaż dobrze rozumiemy korę ruchową, dokładne granice obszarów planowania wyższego poziomu różnią się w zależności od gatunku, a nawet u poszczególnych osób.

„Trzeba włożyć trochę pracy, aby wiedzieć dokładnie, gdzie wszczepić urządzenie danej osobie, ponieważ wiele z tych obszarów nie zostało dobrze zbadanych u ludzi” – wyjaśnia Janssen.

Po zidentyfikowaniu tych dokładnych lokalizacji potencjalne korzyści dla osób z paraliżem będą ogromne. Zamiast próbować opanować kłopotliwe interfejsy oparte na ruchu, użytkownicy będą mogli:

– Poruszaj się po wirtualnych światach w celach rekreacyjnych lub interakcji społecznych.

– Steruj elektrycznymi wózkami inwalidzkimi za pomocą intuicyjnych, kontrolowanych myślami ruchów.

– Interakcja z interfejsami cyfrowymi jest bardziej naturalna, zmniejszając obciążenie poznawcze wymagane do korzystania z technologii wspomagających.

Wniosek

Koncentrując się na abstrakcyjnych ośrodkach planowania w mózgu, a nie tylko na obszarach wykonywania ruchów, badacze są o krok bliżej do stworzenia interfejsów, które sprawiają wrażenie naturalnego przedłużenia umysłu. To przejście od „symulowania ruchu” do „wyrażania zamiaru” może z czasem zapewnić osobom z niepełnosprawnością ruchową znacznie płynniejszy i intuicyjny sposób poruszania się zarówno w rzeczywistości cyfrowej, jak i fizycznej.